随着OpenAI的ChatGPT发布,人工智能领域的投资增加,许多公司开始研究和开发自己的大语言模型。常见的大语言模型有:文心一言(百度)、通义千问(阿里)、讯飞星火(科大讯飞)等。这些模型离线部署的难度可能比较大,那么有没有更简单的方式离线本地体验呢?答案是有的,Ollama + 大语言模型(Gemma)。

什么是Ollama?

Ollama是一款在本地启动并运行大型语言模型的软件,支持Mac、Linux、Windows以及Docker镜像。除此之外Ollama有用于运行和管理模型的REST API,根据Ollama提供的API可以供其他程序的调用。

Ollama平台下载地址:

- Mac下载地址:Download for Mac

- Linux下载命令:

curl -fsSL https://ollama.com/install.sh | sh - Windows下载地址:Download for Windows (Preview)

- Docker镜像:ollama/ollama

Ollama平台支持的大语言模型可以查看ollama.com/library,一些模型信息和运行方式如下:

| Model | Parameters | Size | Download |

|---|---|---|---|

| Llama 2 | 7B | 3.8GB | ollama run llama2 |

| Mistral | 7B | 4.1GB | ollama run mistral |

| Dolphin Phi | 2.7B | 1.6GB | ollama run dolphin-phi |

| Phi-2 | 2.7B | 1.7GB | ollama run phi |

| Neural Chat | 7B | 4.1GB | ollama run neural-chat |

| Starling | 7B | 4.1GB | ollama run starling-lm |

| Code Llama | 7B | 3.8GB | ollama run codellama |

| Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

| Llama 2 13B | 13B | 7.3GB | ollama run llama2:13b |

| Llama 2 70B | 70B | 39GB | ollama run llama2:70b |

| Orca Mini | 3B | 1.9GB | ollama run orca-mini |

| Vicuna | 7B | 3.8GB | ollama run vicuna |

| LLaVA | 7B | 4.5GB | ollama run llava |

| Gemma | 2B | 1.4GB | ollama run gemma:2b |

| Gemma | 7B | 4.8GB | ollama run gemma:7b |

注意:运行 7B 机型至少需要 8GB 内存,运行 13B 机型至少需要 16GB 内存,运行 33B 机型至少需要 32GB 内存。

什么是大语言模型?

大语言模型(LLM)是专门用来理解和生成人类语言的人工智能模型。它们在大量的文本数据上进行训练,可以完成许多任务,包括文本总结、翻译、情感分析等等。LLM的特点是规模庞大,包含数十亿的参数,以及基于深度学习架构的结构,可以学习语言数据中的复杂模式。

大语言模型就像超级计算机,擅长处理大量的文本数据。它们像在房间里一样,充满了各种各样的知识,可以完成很多事情,例如写作、翻译、代码生成等等。

大语言模型的特点:

- 大规模数据集: LLMs 由数十亿或数亿个单词的大规模数据集训练。

- 神经网络架构: LLMs 使用神经网络架构,专门设计用于处理文本数据。

- 迁移学习: LLMs 可以从一个任务转移到另一个相关任务。

- 多任务学习: LLMs 可以执行多个任务,例如文本生成、代码翻译、图像描述等。

- 自然语言处理 (NLP) 功能: LLMs 在 NLP 任务方面表现出色。

- 扩展性: LLMs 可以扩展到大型数据集,并处理大量的文本数据。

- 学习能力: LLMs 可以从大量数据中学习新的知识和技能。

- 解释性: 某些 LLMs 包含解释性机制,允许人类了解模型的决策过程。

- 持续发展: LLMs 是不断发展的技术,随着新数据的加入和改进,它们在性能和功能方面不断提高。

Ollama + 大语言模型(Gemma)

1. 下载并安装Ollama软件

打开软件直接下一步即可,过程略。

安装完成效果描述:

- Mac安装完成之后,会有一个窗口,提示安装完成并推荐安装llama2大模型的语句

- Windows安装完成之后,会打开命令提示符,提示安装完成并推荐安装llama2大模型的语句

2. 选择Ollama平台支持的LLM进行安装

进入Mac的终端或Windows的命令提示符,执行 ollama run 大模型:数据量 命令进行安装对应的大模型。

Ollama支持的一些LLM如上文所示,详情请查看链接:ollama.com/library

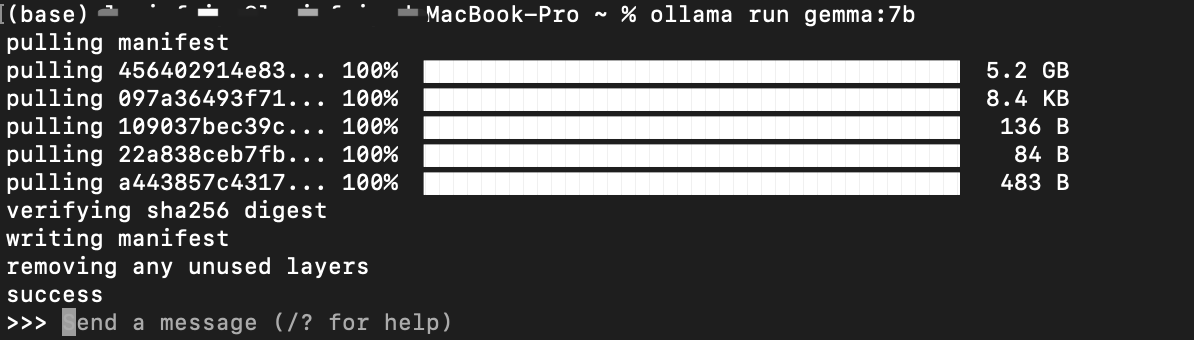

安装完LLM后,会直接进入窗口对话,效果图如下所示:

3. 体验本地ChatGPT

注意:Windows的命令提示符窗口可能不支持中文输入,需要设置

本地搭建图形化界面

在Windows的命令提示符或Mac的终端是可以体验的,但体验效果可能并不是很好。故搭建图形化界面,提升体验感。

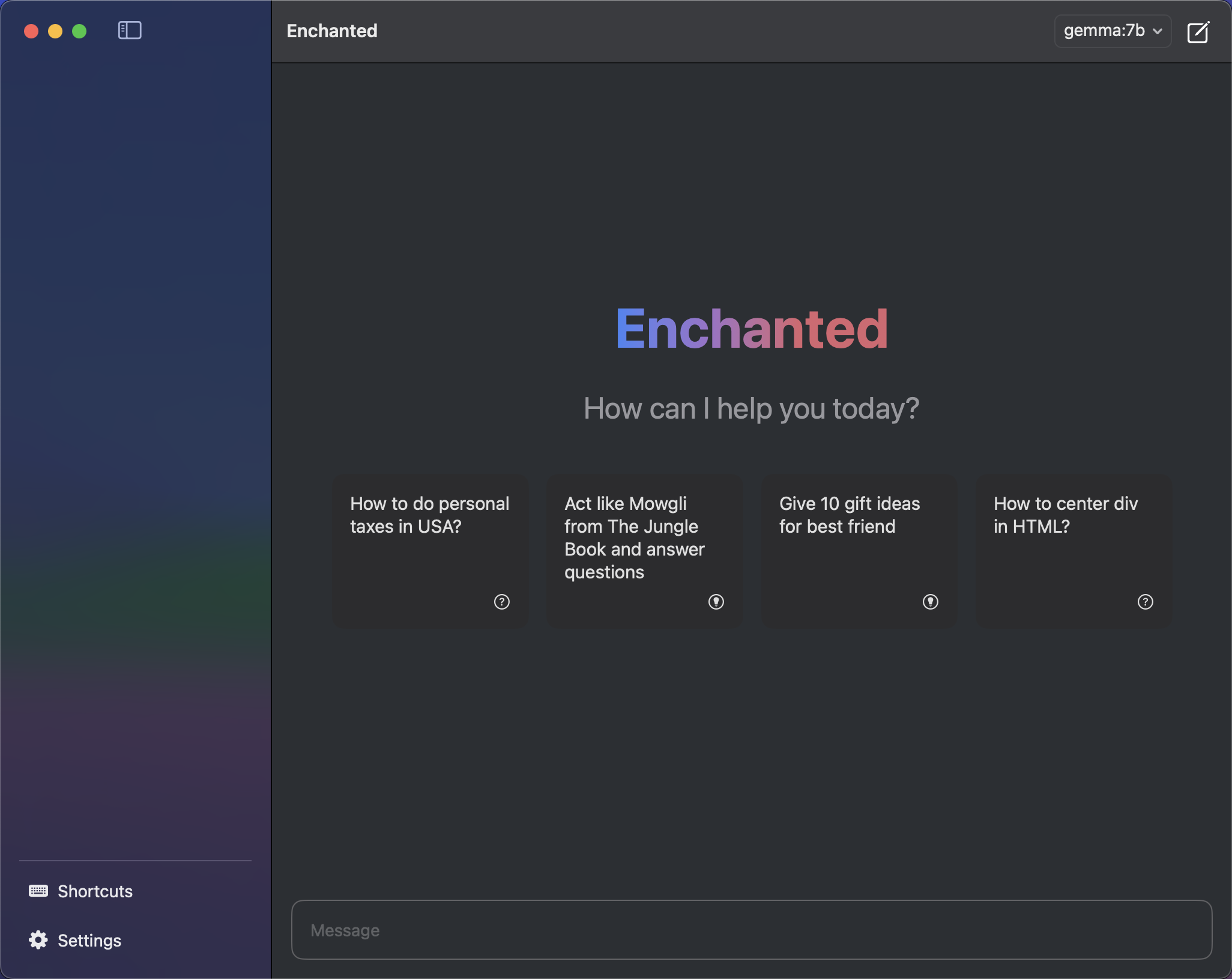

1. Mac平台推荐

- Enchanted(软件):Enchanted

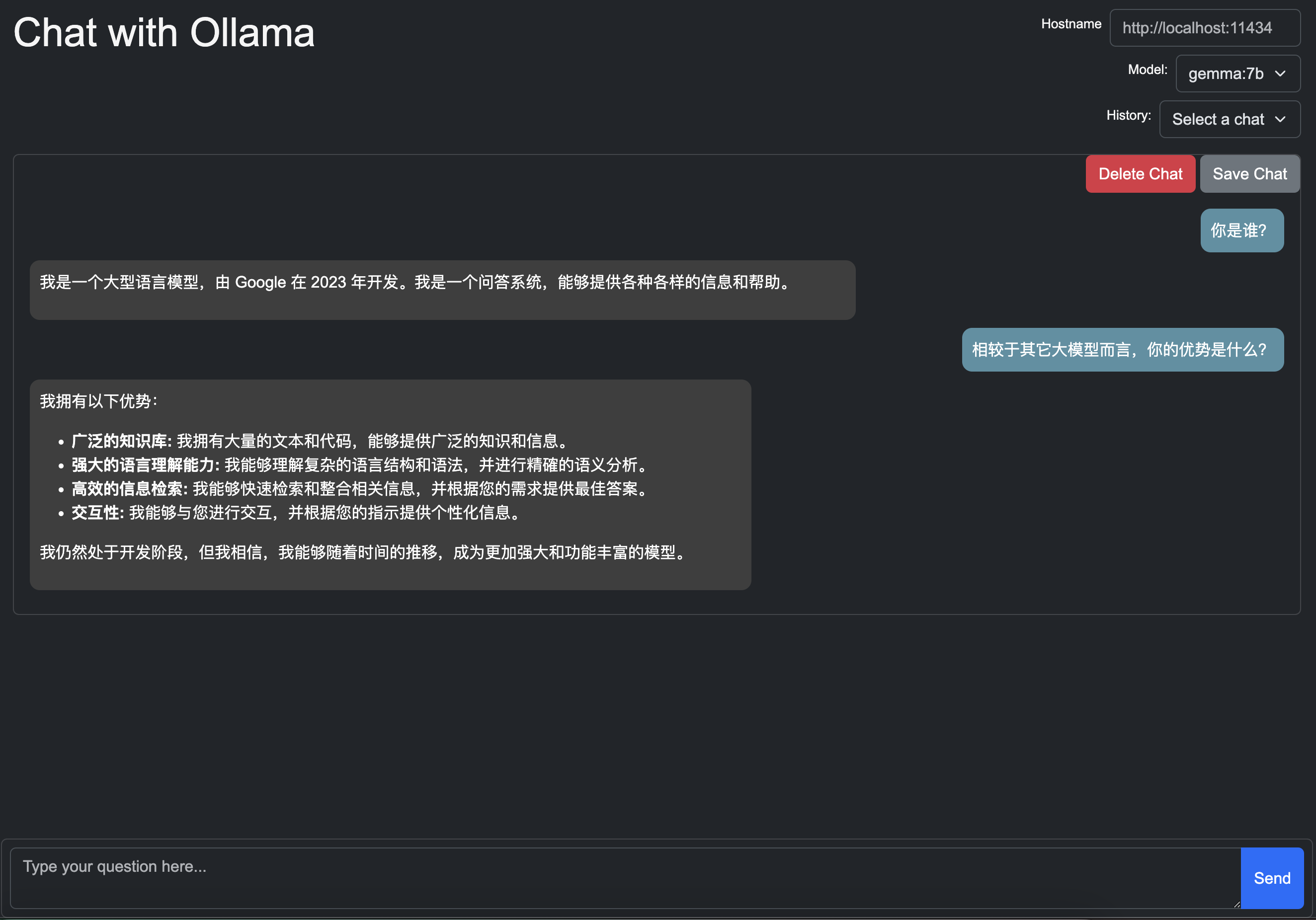

- HTML UI(Web):HTML UI

- Chatbot UI(Web):Chatbot UI

- Open WebUI(Web):Open WebUI

2. Windows平台推荐

- HTML UI(Web):HTML UI

- Chatbot UI(Web):Chatbot UI

- Open WebUI(Web):Open WebUI

3. Linux平台推荐

- HTML UI(Web):HTML UI

- Chatbot UI(Web):Chatbot UI

- Open WebUI(Web):Open WebUI

4. Docker平台推荐

- Chatbot UI(Web):Chatbot UI

- Open WebUI(Web):Open WebUI

5. 部分图形化效果

Mac平台Enchanted,界面如下所示:

Mac平台HTML UI,界面如下所示:

评论区